Google sorprende con una nueva noticia: todos los contenidos subidos a Drive serán escaneados y podrán ser restringidos. Con los dilemas de la privacidad y la censura en boca del mundo, una decisión así deja abierta muchas preguntas. Al mismo tiempo, se perfila como una manifestación de cambios que podrían extenderse, con el tiempo, a muchos otros servicios..

O cumples o se va

El nuevo sistema de Google se sustentará tanto en base a la ley como en base a sus propias políticas internas. En ese sentido, no solo se eliminará el contenido detectado como ilegal, sino todo aquello a lo que Google considere inapropiado. Esto último es lo que ha llamado la atención de la opinión pública, ¿qué no es apropiado para Google y por qué?

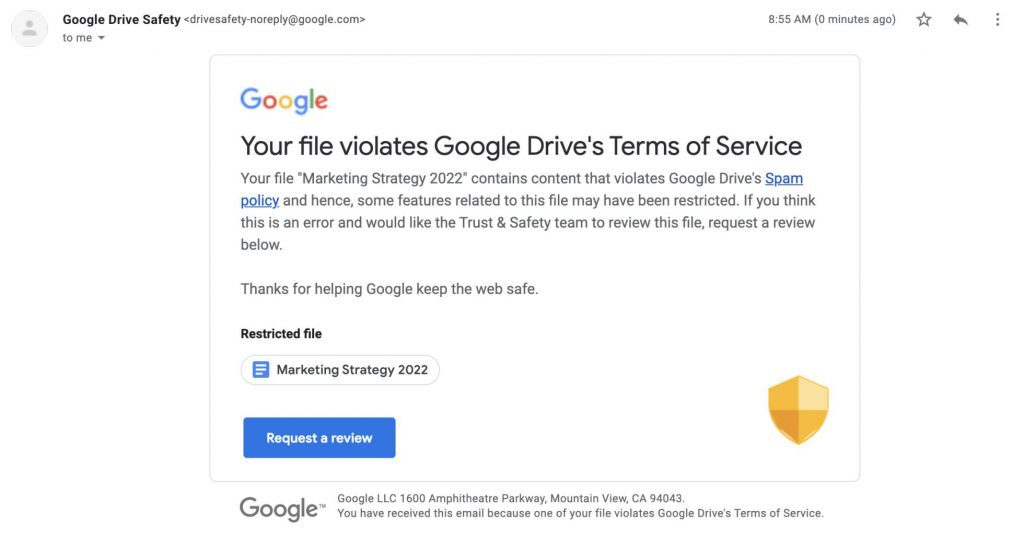

Google lo deja muy claro: malware, contenido sexual explícito, contenido que ponga en riesgo a los niños y discursos de odio. Vamos, algo con lo que la mayoría estará de acuerdo. Sin embargo, el problema es que es un algoritmo el que determina, en primera instancia, si algo es inapropiado o no. Frente a esto, Google indica que añadirá una opción para apelar la decisión y poder brindar explicaciones. Llegado a ese punto, sería un humano quien daría la segunda revisión.

Pero… ¿qué pasa si este baneo erróneo es recurrente?

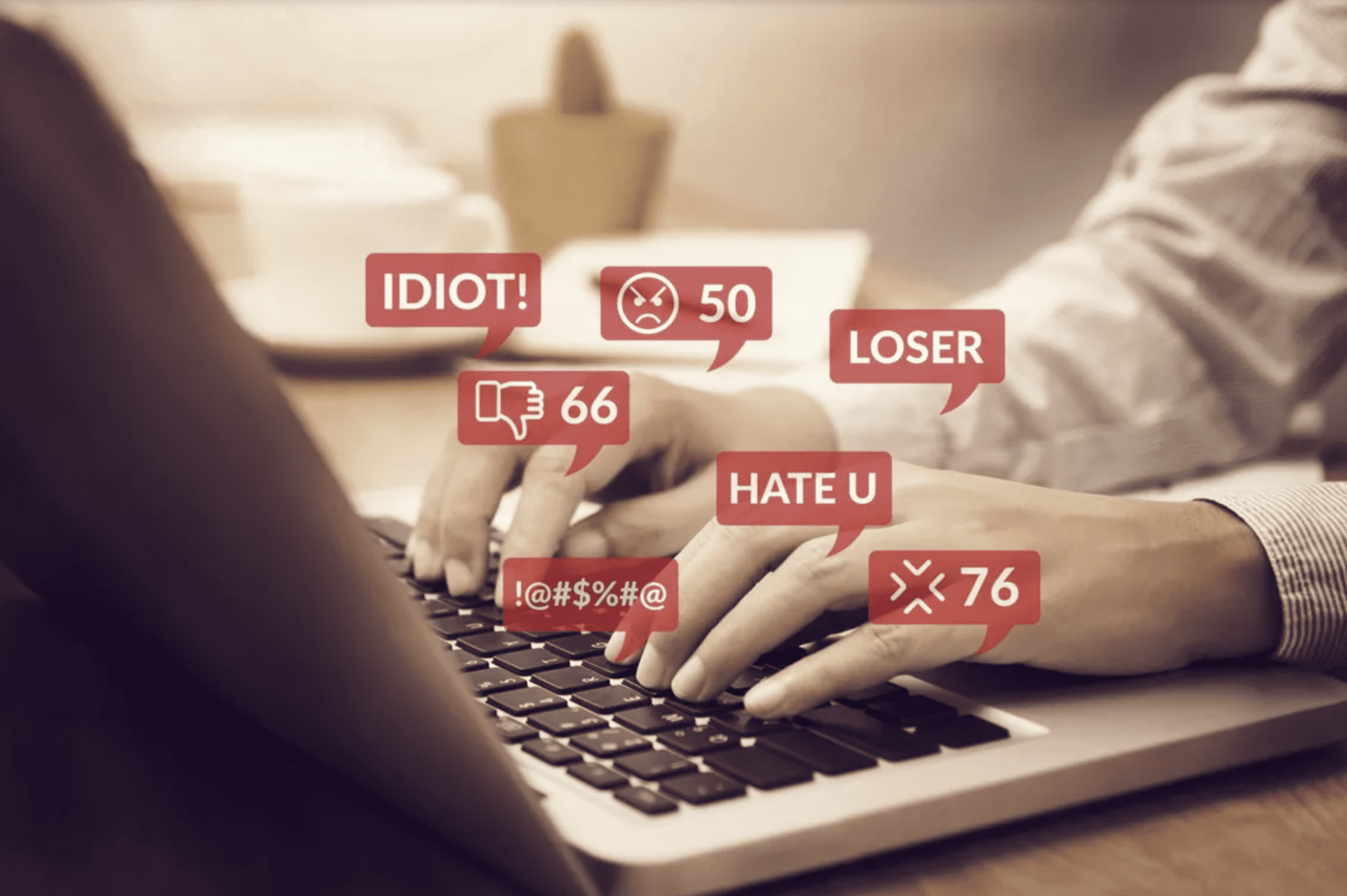

Discursos de “odio”

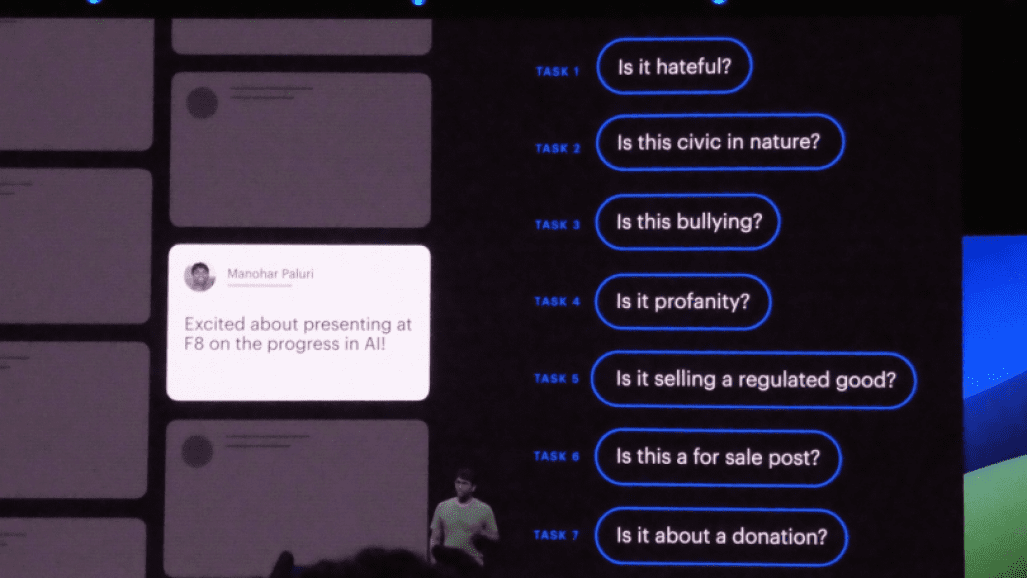

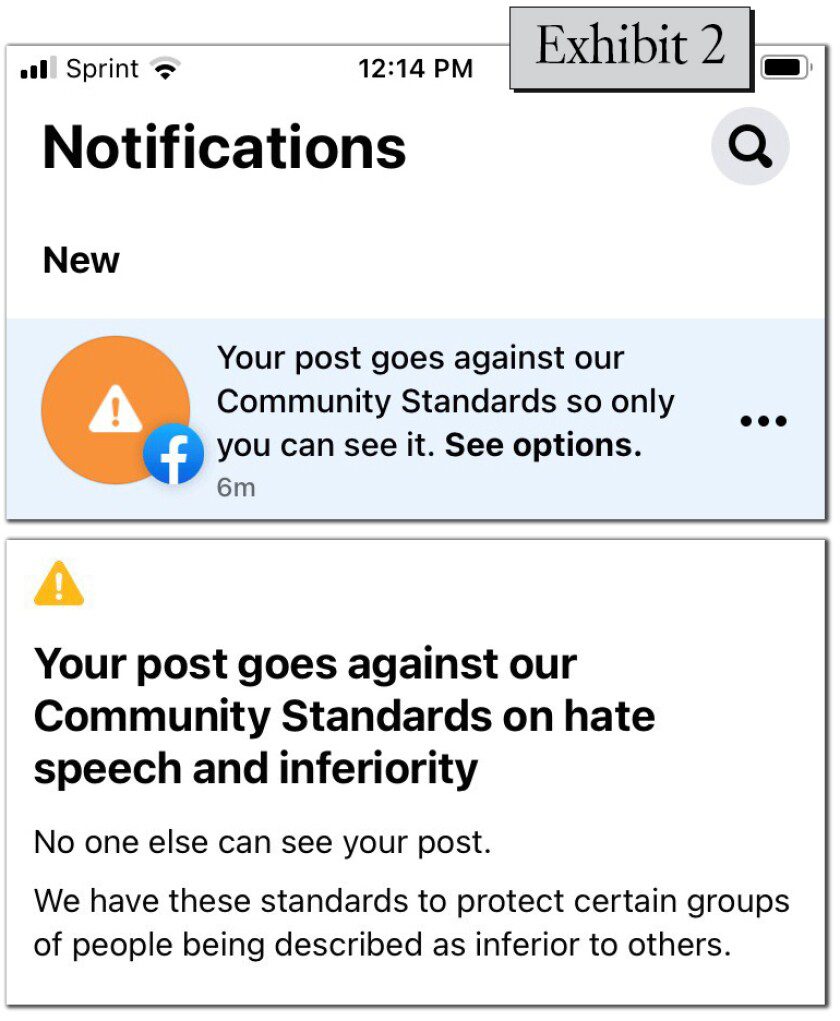

Un problema que viene enfrentando Facebook, desde hace mucho, es la censura imprecisa por discursos de odio que realiza el algoritmo. ¿Cómo determina la máquina la intención con la que expresas algo? ¿Cómo sabe si estás insultando o “mencionando” un insulto? ¿Podría terminar parcializándose a favor de ciertos intereses políticos o ideológicos?

En 2017, The Guardian pudo acceder a más de 100 documentos que revelaron cuestionables e ineficientes mecanismos para este proceso de censura. Cuatro años después, con el reciente escándalo desatado por una ex-trabajadora de Facebook, se llegó a informar que el problema persistía, con una serie de cifras preocupantes.

La pregunta entonces es si Google habrá hallado su propia forma de solucionarlo. Imaginemos que poseemos un documento que habla sobre temáticas vinculadas al racismo, en donde hacemos mención de insultos recurrentes, ¿Google sabrá que es con propósitos de análisis o lo tomará como discurso de odio?

Y claro, ni hablemos del artista que involucre desnudos en sus obras, ¿cómo enseñarle a un algoritmo a detectar si una foto es arte o no? Situaciones así, ambiguas, se pueden plantear por montones.

Google y un futuro no tan distante

Hay que entender que estas medidas han sido tomadas como reacción a la nueva normativa DSA que se está tramitando en el Parlamento Europeo. Esta nueva normativa señala, a groso modo:

“Poner en manos de las grandes plataformas tecnológicas la responsabilidad de controlar el contenido que se publica en ellas.”

Hay quienes discuten que esta medida es, en realidad, irresponsable, porque se estaría entregando el control de lo que se dice o no se dice, a las grandes empresas. Recuerden, no solo sería bajo la ley, sino bajo sus propias políticas. Políticas que al fin y al cabo decide un directorio.

Sin embargo, esto no tiene por qué ser negativo. Podemos ver que las políticas que aplican estas corporaciones son, al menos en papel, afines al pensamiento moral común de las personas. Si eso no se utiliza con fines maquiavélicos, es decir, en pro de intereses particulares, no tendría por qué haber un problema importante. Claro, más allá de los problemas generados por los algoritmos, algo que se supone ya están trabajando.

Si algo hemos visto en anteriores artículos, es que la reputación y la prevención de una crisis sigue siendo una prioridad. En ese sentido, el valor de la reputación actúa como un mediador entre los intereses del público y los intereses particulares de la empresa. En cuanto este acuerdo empieza a tirar más de un lado, los problemas surgen y los cambios se hacen necesarios. Una suerte de mano invisible regulando.

Esperemos que sea la perspectiva esperanzadora la que prevalezca tanto en Google como en el futuro de la privacidad en línea.